An improved VIO front-end method based on inertial prior correction of image grayscale

-

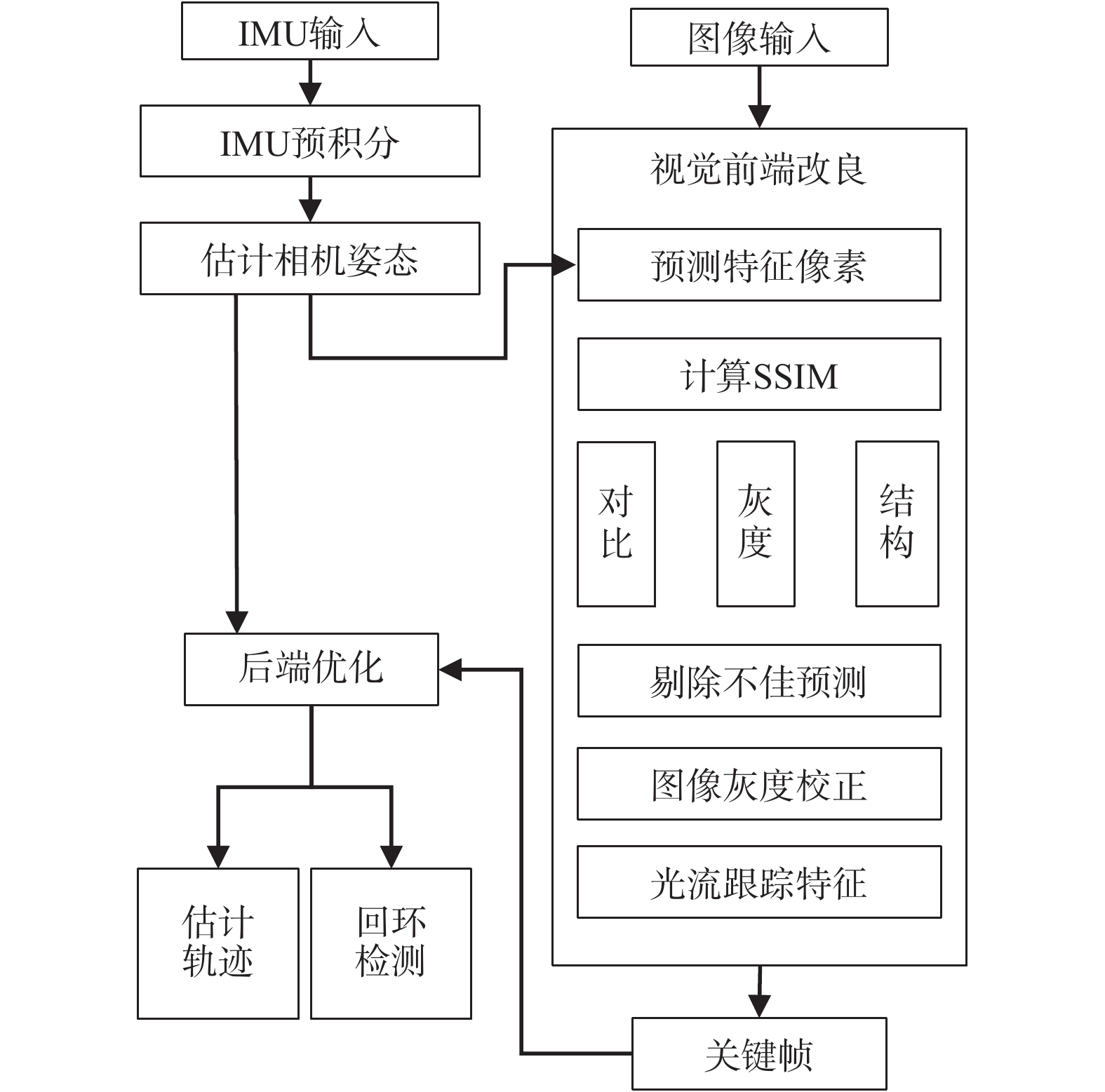

摘要: 针对封闭环境中不同光照场景导致相机图像序列光照过强、过弱以及光照强度大幅变化等问题,提出了一种基于惯性先验预测并校正图像灰度、提升光流跟踪成功率的视觉惯性里程计(VIO)前端改良方法,以解决由于极端光照条件导致的特征点跟踪失败问题. 该VIO前端改良算法通过以惯性预测特征点像素位置,并衡量图像序列中对应特征点邻域之间的相似性对当前图像灰度进行伽马校正. 通过TUM数据集实验验证,所提算法定位精度比VINS-Mono平均提升了17.7%;在真实的室内外环境下进行实验,相较于VINS-Mono有更好的表现.

-

关键词:

- 即时定位与地图构建(SLAM) /

- 视觉惯性里程计(VIO) /

- 图像增强 /

- 灰度校正 /

- 特征跟踪

Abstract: Aiming at the problems of camera image sequences with excessive or weak illumination and significant changes in illumination intensity due to different lighting scenarios in a closed environment, a visual-inertial odometer (VIO) system based on inertial prior prediction to enhance images was proposed to solve the problem of features tracking loss due to extreme lighting conditions. This image enhancement algorithm performs grayscale gamma correction on the current image by predicting the pixel positions of feature points using inertia and associating the grayscale relationships between the corresponding feature point neighborhoods in the front and rear images. Experimental verification with TUM dataset shows that the proposed algorithm has an average improvement of 17.7% in positioning accuracy compared to VINS-Mono. Experiments in real indoor and outdoor environments also show better performance compared to VINS-Mono.-

Key words:

- SLAM /

- VIO /

- image enhancement /

- gray scale correction /

- feature tracking.

-

表 1 TUM数据集特征跟踪耗时

数据集序列 本文方法/ms VINS-Mono/ms dataset-corridor1_512_16 21.553 7.884 dataset-corridor2_512_16 19.354 7.655 dataset-corridor3_512_16 13.365 7.113 dataset-corridor4_512_16 22.681 8.257 dataset-room1_512_16 16.225 7.915 dataset-room2_512_16 11.436 6.715 dataset-room3_512_16 12.352 6.914 dataset-room4_512_16 19.231 8.132 dataset-room5_512_16 18.364 7.875 dataset-room6_512_16 15.946 7.294 表 2 TUM数据集定位误差(RMSE)

数据集序列 本文方法/m VINS-Mono/m dataset-corridor1_512_16 0.035 0.038 dataset-corridor2_512_16 0.020 0.027 dataset-corridor3_512_16 0.035 0.036 dataset-corridor4_512_16 0.183 0.279 dataset-room1_512_16 0.032 0.076 dataset-room2_512_16 0.088 0.136 dataset-room3_512_16 0.410 0.585 dataset-room4_512_16 0.039 0.088 dataset-room5_512_16 0.172 0.210 dataset-room6_512_16 0.146 0.241 表 3 真实环境定位RMSE

数据 本文方法/m VINS-Mono/m 序列1 1.552 1.721 序列2 2.491 3.345 -

[1] CHEN W F, SHANG G T, JI A H, et al. An overview on visual SLAM: from tradition to semantic[J]. Remote sens, 2022, 14(13): 3010. DOI: 10.3390/rs14133010 [2] 高云峰, 周伦, 吕明睿, 等. 自主移动机器人室内定位方法研究综述[J]. 传感器与微系统, 2013, 32(12): 1-5. [3] QIN T, LI P L, SHEN S J. VINS-Mono: a robust and versatile monocular visual-inertial state estimator[J]. IEEE transactions on robotics, 2018, 34(4): 1004-1020. DOI: 10.1109/TRO.2018.2853729 [4] MUR-ARTAL R. , JUAN D T. ORB-SLAM2: an open-source SLAM system for monocular, stereo, and RGB-D cameras[J]. IEEE transactions on robotics, 2017, 33(5): 1255-1262. DOI: 10.1109/TRO.2017.2705103 [5] MOURIKIS A S, ROUMELIOTIS S I. A multi-state constraint kalman filter for vision-aided inertial navigation[C]// Proceedings 2007 IEEE International Conference on Robotics and Automation, 2017. [6] HE Y J, ZHAO J, GUO Y, et al. PL-VIO: tightly-coupled monocular visual-inertial odometry using point and line features[J]. Sensors, 2018, 18(4): 1159. DOI: 10.3390/s18041159 [7] NIU X J, TANG H L, ZHANG T S, et al. IC-GVINS: a robust, real-time, INS-Centric GNSS-visual-inertial navigation system[J]. IEEE robotics and automation letters, 2023, 8(1): 216-223. DOI: 10.1109/LRA.2022.3224367 [8] ZHU S N, YANG S M, HU P Y, et al. A robust optical flow tracking method based on prediction model for visual-inertial odometry[J]. IEEE robotics and automation letters, 2021, 6(3): 5581-5588. DOI: 10.1109/LRA.2021.3079806 [9] SONG Z X, ZHANG X B, LI T Y, et al. IR-VIO: Illumination-robust visual-inertial odometry based on adaptive weighting algorithm with two-layer confidence maximization[J]. IEEE/ASME transactions on mechatronics, 2022: 1-10. DOI: 10.1109/TMECH.2023.3277031 [10] LAND E H. An alternative technique for the computation of the designator in the retinex theory of color vision[J]. Proceedings of the national academy of sciences of the United States of America, 1986, 83(10): 3078-3080. DOI: 10.1073/pnas.83.10.30 [11] JOBSON D J, RAHMAN Z, WOODELL G A. A multiscale retinex for bridging the gap between color images and the human observation of scenes[J]. IEEE transactions on image processing, 1997, 6(7): 965-976. DOI: 10.1109/83.597272 [12] KAIMING H, SUN J, TANG X O. Single image haze removal using dark channel prior[C]// IEEE Conference on Computer Vision and Pattern Recognition, 2019. [13] PISANO E D, ZONG S, HEMMINGER B M, et al. Contrast limited adaptive histogram equalization image processing to improve the detection of simulated spiculations in dense mammograms[J]. Journal of digit imaging, 1998, 11(4): 193-200. DOI: 10.1007/BF03178082 [14] 高扬, 王兴奔, 徐永贵, 等. 低光照条件下的鲁棒视觉惯性SLAM算法[J]. 组合机床与自动化加工技术, 2022(6): 39-44. [15] 尹胜楠, 崔学荣, 李娟, 等. 基于快速ACE算法的视觉里程计图像增强方法[J]. 电子测量与仪器学报, 2021, 35(6): 27-33. [16] TOMASI J, WAGSTAFF B, WASLANDER S L, et al. Learned camera gain and exposure control for improved visual feature detection and matching[J]. IEEE robotics and automation letters, 2021(99): 1-1. DOI: 10.1109/LRA.2021.3058909 [17] 高翔, 张涛. 视觉SLAM十四讲: 从理论到实践[M]. 北京: 电子工业出版社, 2017. -

下载:

下载: